各公司如何转向聚变初创公司、核能交易,甚至自建能源供应系统,保持领先地位。

如果能源供应无法同步增长,人工智能就无法持续扩展。

然而,即便获得了电力,这仅仅是开始。

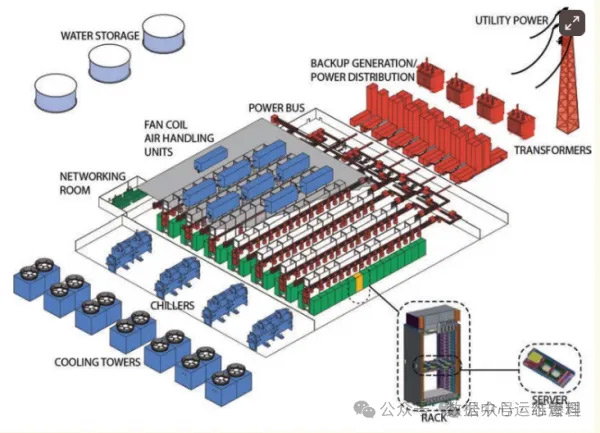

电力最终还是要输送到某个地方,那就是数据中心。

大多数老旧的数据中心并非为此而建,这意味着它们的冷却系统已经无法满足需求。数据中心的布局、电网连接以及热量在建筑内的流动方式都需要与时俱进,以满足人工智能时代不断变化的需求。

探讨这些数据中心内部正在发生(或应该发生)的变化:浸没式冷却槽、更智能的电网协调以及如今对人工智能发展至关重要的静默式改造。

传统数据中心为何开始崩溃

人工智能工作负载的激增,已经使原本设计用于支持此类工作负载的数据中心不堪重负。

传统数据中心的设计初衷是用于通用计算,每个机架的功率密度约为7至8千瓦,高端机型可能达到15千瓦。

然而,运行在英伟达GB200等新一代芯片上的人工智能集群的功耗已经远远超过了这些数字。

如今,机架的功耗通常达到30千瓦甚至更高,某些配置的功耗甚至接近100千瓦。

麦肯锡指出,功率密度的快速增长导致 基础设施能力与人工智能计算需求之间出现不匹配。

曾经绰绰有余的电网连接如今已不堪重负。冷却系统,尤其是传统的空气冷却系统,无法快速有效地散热,以满足不断增长的热负荷。

在许多情况下,建筑物本身的物理布局会成为问题,无论是楼层的承重限制还是机架之间的间距。

即使是传统数据中心内部的基本电源转换和分配系统,额定电压和电流也往往不足以支持人工智能机架。

正如Greenlight数据中心首席执行官Alex Stoewer说的那样,“鉴于这种密度水平是前所未有的,当这些芯片上市时,很少有现有的数据中心配备了相应的配电或液冷系统。任何想要运行这些新芯片的人都需要进行新的开发或材料改造。”

基础设施的差距正是在这里真正显现出来。

许多老旧设施根本无法及时完成升级。

即使电网供电可用,并网审批和许可的延误也会使改造进程变得异常缓慢。

高盛现在将这种转型描述为向“超高密度计算环境”的转变,在这种环境中,甚至连气流和机架布局都必须从头开始重新设计。

散热问题比你想象的要严重得多

如果你走进一座几年前建成的数据中心,试图以全负荷运行当今的人工智能工作负载,冷却系统往往是最先出现问题的部件。

它不会一下子全部失效,而是各个部件逐渐损坏,问题不断累积。

气流受阻,功耗飙升,可靠性下降。所有这些最终都会导致系统崩溃。

传统的空气冷却系统并非为应对这种高温而设计。

一旦机架功率超过30或40千瓦,仅仅输送和冷却这些空气所需的能量就成了问题。麦肯锡公司认为,风冷系统的上限约为每个机架50千瓦。但如今的人工智能集群的功率早已远远超过这个限制。有些 甚至达到了80或100千瓦。

如此高的热量会破坏整个设施的平衡。

这就是为什么越来越多的运营商开始采用浸没式和液冷技术。这些系统使用液体而非空气直接从热源吸收热量。

有些方案将服务器完全浸没在非导电液体中,而另一些方案则将冷却液直接输送到芯片。这两种方案都能提供更佳的散热性能和更高的规模化效率。

在某些情况下,运营商甚至会将这些热量用于为附近的建筑物或工业系统供电。

然而,这种转变并非如人们想象的那般简单。液冷需要新的硬件、管道和持续的维护。

因此,它需要空间和周密的规划。

但是,随着密度的增加,继续使用风冷不仅效率低下,还会严重限制数据中心的扩展能力。

运营商意识到,他们无法通过调整风冷方案来突破100千瓦机架的限制,因此必须出现其他解决方案。

这些方案也确实出现了。

浸没式冷却的优势

长期以来,浸没式冷却技术一直被认为是一种过度设计。

理论上固然有趣,但大多数运营商并未认真考虑过。

如今情况已有所改变。随着设施的运行温度接近空气和基础液体系统的极限,浸没式冷却似乎成了唯一真正的选择。

浸没式散热并非试图通过强制更多空气吹过温度更高的机架,而是另辟蹊径。

服务器直接浸入不导电的液体中,被动地带走热量。

有些系统甚至 使用在封闭容器内沸腾和冷凝的液体, 几乎没有任何移动部件就能将热量散发出去。

这种散热方式更安静、密度更高,而且在满负荷运行时通常也更稳定。

尽管浸没式冷却的优势显而易见,但部署这项技术仍需周密规划。

冷却罐需要占用物理空间,冷却液也需要前期投入。

然而,与重新设计整个风冷式冷却设施或为了控制负荷而降低工作负荷相比,浸没式冷却正逐渐成为一种更为直接的选择。

对许多运营商而言,这不再是一项实验,而是势在必行的下一步。

从计算中心到能源节点

如果浸没式冷却解决了散热问题,那么时间安排呢?

何时才能真正从电网获取如此大的电力?这正成为下一个瓶颈,并迫使超大规模数据中心的运营方式发生转变。

谷歌已经与田纳西河谷管理局(TVA)等区域性公用事业公司签署了正式的需求响应协议 。

这项协议不仅降低总能耗,还能控制电力的使用时间和地点。

人工智能工作负载,尤其是训练任务,本身就具有灵活性。

借助合适的软件栈,这些作业可以跨设施迁移,或者将执行时间延迟数小时。

这种延迟本身就成为了一种工具。

它可以用来避免电网拥堵、吸收过剩的可再生能源,或者在系统负荷紧张时维持正常运行时间。

不仅仅是谷歌。微软也一直在数据中心测试能源匹配模型,包括根据清洁能源的可用性来安排作业。

落基山研究所预测,数据中心与电网动态的匹配可以释放数吉瓦的闲置容量。

毋庸置疑,这些并非可持续发展的姿态,而是生存策略。

电网排队现象日益严重,审批时间不断延长,互联容量限制正成为人工智能基础设施发展的真正瓶颈。

能够蓬勃发展的设施不仅需要良好的冷却系统,还需要具备电网智能、灵活的合同机制以及快速响应能力。

因此,从计算中心到能源节点,关键不再仅仅在于你需要多少电力,而在于你如何与电力供应系统协同运作。

为人工智能而设计意味着重新思考一切

你不能再像过去数据中心处理通用计算那样来设计人工智能系统了。

负载更重,温度更高,而且运行速度更快。

你会发现,机架的耗电量比十年前整个服务器机房还要高,周围的一切都必须做出相应的调整。

如今的新建工程采用由内而外的设计理念。

工程师首先确定工作负载概况,然后根据集群的实际需求来规划气流、冷却路径、线缆走向,甚至结构支撑。

在某些情况下,不同类型的作业会拥有各自独立的电气区域。这意味着独立的冷却回路、更短的线缆、专用的开关设备——多个系统在同一屋檐下协同工作。

电力输送也在发生变化。

安德森电力公司解释说:“为了达到所需的机架密度,设备正在利用更高的电压,同时增加电流。这也要求开发相应的组件和基础设施来妥善输送电力。”

这种转变不仅仅关乎效率,更关乎生存。

如果数据中心没有采用热能回收、预留扩展空间和灵活的电气设计,就无法长期生存下去。需求不会放缓,基础设施必须迎头赶上。

这种基础设施转变对未来意味着什么

我们知道,单靠硬件已经无法取得突破性进展。

真正的优势在于能够快速上线,不受电力、许可和其他障碍的阻碍。

这正是问题开始显现的地方。

选址已成为一项至关重要的筛选环节。

一块价格低廉的土地远远不够。你需要的是公用设施容量、当地支持,以及无需数月谈判即可实现的后续发展空间。

即使是拥有雄厚资源的项目,也常常遭遇资金瓶颈。

那些领先一步的公司起步很早。

微软已经在建设能够处理千兆瓦级负荷的多园区。谷歌正在将设施扩张与灵活的能源合同和附近的可再生能源相结合。

亚马逊甚至在许可证生效之前,就已经在重新设计电力系统并与规划部门合作。

如今压力持续存在,任何延误都会波及各个方面。

错过一个关键窗口,就会损失训练周期。模型开发的速度不会等待基础设施跟上。

后端规划曾经是前线策略,而现在,数据中心建设者才是决定未来走向的关键。

展望未来,人工智能的性能将不再仅仅以浮点运算次数或延迟来衡量,最终将取决于谁能在真正关键的时刻完成建设。

来源:数据中心运维管理